質問を入力すると文章で回答してくれる「ChatGPT」は、その情報量やスピードに多くの人が驚き、大きな関心が寄せられています。

今後広い分野での活躍が期待される一方、セキュリティなどを懸念して欧州などで規制の動きも出ています。

ChatGPTには何ができるのか、どういった点に注意が必要なのか、関係各所の動きとともに見ていきましょう。

ChatGPTに色々と質問してみた

ChatGPTについての記事を書くにあたって、筆者自身もChatGPTにいくつか簡単な質問をしてみました。

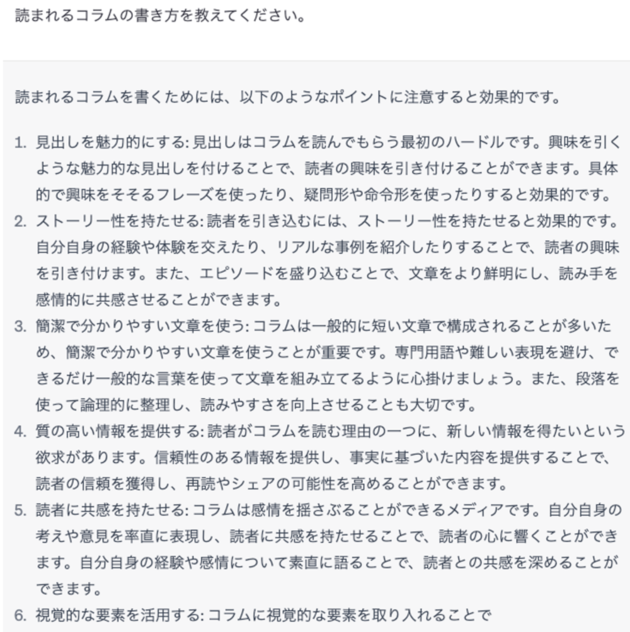

筆者が仕事にしているのは記事やコラムを書くことです。そうである以上、自分が書いたものが多くの人の目に留まってくれるのは嬉しいことですから、どうすれば良いかChatGPTにたずねてみました。

その結果が下です。

なるほど一般論は網羅されているな、というのが筆者の第一印象です。それにしても、機械とは思えない、人が答えているようなすらすらとした文章には関心してしまいます。

次に、システムセキュリティの上で知っておきたい「Mirai」というマルウェアについて質問してみました。

これも、筆者が知っていることと概ね一致しています。もしかしたら筆者よりも説明が上手かもしれません。

しかし、どんな質問にでも答えてくれるわけではありません。むしろ、「答えないことができる」ことに筆者は関心しました。例えばこのような質問です。

さすがに、犯罪の手口は教えてくれないようです。

では、筆者が応援している球団についてたずねてみました。

そう言われてしまえばその通りです。不確かなことには触れないようにする、という責任感はあるようです。

なお、いずれの質問も、リアルタイムで答えが返ってきました。「少々お待ちください」といった時間がなかったことには驚きました。

国内初・自治体でのChatGPTの試験的利用

さて、検索エンジンを使うよりも欲しい情報に瞬時にアクセスでき、文章を書く速度も人間より早いであろうChatGPTは、その利点をいかして様々なところで利用されはじめています。

神奈川県横須賀市役所は4月20日から、全国で初めて業務への活用に乗り出しました。1か月の試験的な運用ではありますが、全面的に自治体の業務に導入するのは全国初だということです*1。

文章作成や議事録の要約、政策立案などにChatGPTを利用し、使い勝手やコストを検証するのが今回の試験運用です。場合によっては人がいちから文章を作る場合に比べ半分以下の時間でできあがることもあり、横須賀市は業務の効率化を期待しているところです。

省庁でも活用へ

また、農林水産省もChatGPTを一部業務で利用します*2。

こちらは行政手続きの申請時に使うマニュアル文書の書き換えへの活用です。これまでは業者に委託していましたが、短期間の作業では業者の負担も大きく、文章の表現が一部分かりにくくなってしまっているという課題があり、これを解消するのが目的です。

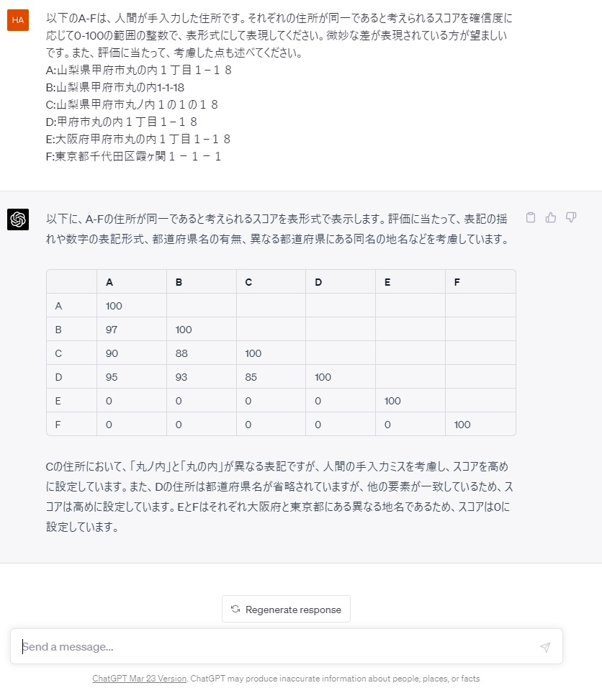

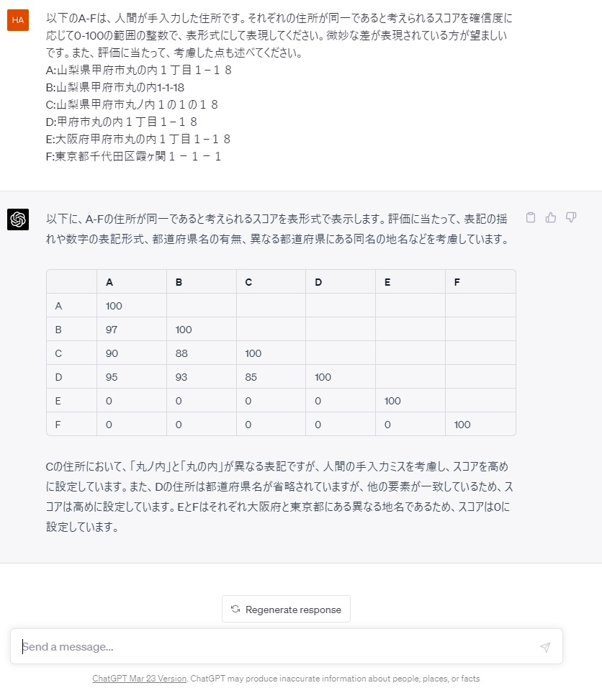

昨年から、行政で頻繁に発生する事務作業の一例として似た地名を突合するために確信度に応じたスコアを表示させることなどを試しています(図1)。

図1 ChatGPTによる類似地名の突合

(出所:「農水省が4月中にも中央省庁初のChatGPT利用、先陣切って実際の業務で使うワケ」日経クロステック)

https://xtech.nikkei.com/atcl/nxt/column/18/02423/041300003/?P=2

上の図に挙げられているのは、同じ「丸の内1丁目1番地18号」であっても、表記のしかたや都府県が違うものです。A、B、C、Dが同じ場所を示しているのは人が見ればわかります。同様にChatGTPもB、C、DがAと同じであることを高いスコアで示しています。

このスコアが、人間が手作業で行う際に生じる見落としやミスよりも高ければ、それはChatGPTに任せられる仕事ということになるでしょう。

海外では規制の動きも

こうした利便性の一方で、ChatGPTのサービスを停止する国も出ています。

イタリア当局は、ChatGPTのデータ収集方法に疑義をとなえ、国内でのサービス一時停止にまで発展しました。

おもに、回答が必ずしも事実とは一致しないことから不正確な形で個人データが取り扱われている可能性があること、利用の際に年齢確認の手続きがないために未成年者などが年齢などにふさわしくない不適切な回答を受ける恐れがあることを問題視した措置です*3。

同様に、アメリカではAIの倫理問題を調査するNGOが、ChatGPTを開発したベンチャー企業「オープンAI」が開発する最新AI「GPT-4」の商業利用を差し止めるよう要請しています*4。

このNGOは、どのようにデータを集めているかといった透明性や、提供する情報に偏見を含まないようにする公平性に欠けると主張しています。

確かに情報の漏洩は、個人だけでなく企業にとってもリスクになります。

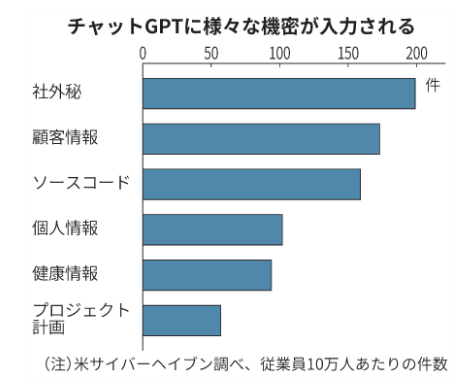

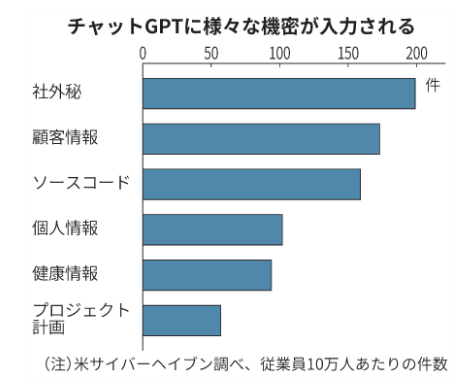

米サイバーヘイブンが同社の製品を使う160万人の従業員を対象にChatGPTの利用実態を調査したところ、8.2%が少なくとも1回はChatGPTを利用し、3.1%が所属企業の機密データを入力してしまったといいます(図2)。

図2 サイバーヘイブン社によるChatGPT使用状況

(出所:「ChatGPT、情報漏洩を防ぐには? データ専門家に聞く」日本経済新聞)

https://www.nikkei.com/article/DGXZQOUC229FO0S3A320C2000000/

また、人材採用SNSの米フィッシュボールがChatGPT利用者約1万2000人を対象に実施した調査では、ChatGPTを業務で使う従業員の68%が、使用状況を上司に伝えていなかったということです*5。

この状況では、誰がどんな機密情報をうっかり入力してしまっているか把握できません。

ルール作りのもとでの活用を

とはいえ、今後法規制も含めたさまざまな部分でChatGPTが精度を上げていけば、広い可能性を秘めているツールになり得るのは事実です。

先に紹介した横須賀市の場合は、AIによって効率化できる業務は効率化し、職員は福祉分野など人だからこそできる仕事に注力できるようにしたい、という狙いがあります*6。

まだ登場したての技術であり、クリアすべき課題も多いというのも事実です。横須賀市の事例で言えば、市の人口についてChatGPTは「2021年9月時点でおよそ42万5000人」と回答しましたが、質問時点での人口はおよそ38万5000人だったということもあったといいます*7。

データの更新頻度にも気を付ける必要があるのです。

しかし一方で、的確な活用を模索する動きもあります。

埼玉県の戸田市では、ChatGPTを自治体の業務で安全に利用するためのガイドブックを作成し、早ければ秋頃に公表したいとしています*8。

また、企業の間ではChatGPTのような「生成形AI」を独自の形にアレンジしたり、独自開発する動きもあります*9。

今、AI技術は日々進展しており、様々な業務における利活用が生産性向上など企業の競争力にも繋がる時代でもあります。

様々な議論があるところですが、これらの技術をいかにうまく活用するか、どのようにリスク管理すべきかという問題からは逃げられそうにありません。

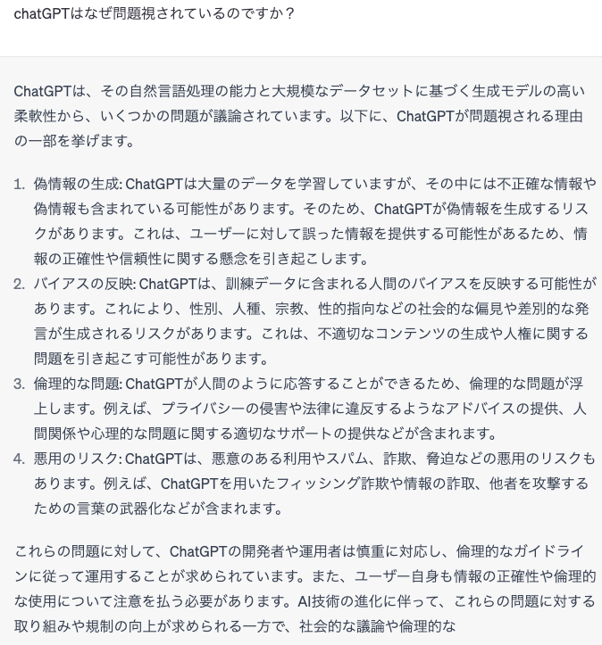

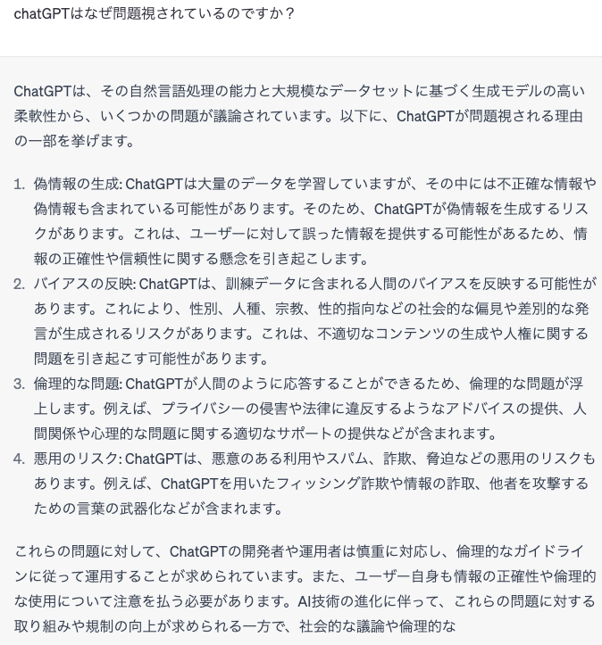

なお、ChatGPT自身にChatGPTが問題視される理由をたずねたところ、このような回答がありました。

これらの課題の解消を期待し、同時に社内でのルール作りを議論することは今から始めても早すぎることはありません。

*1、6、7、8

「行政機関も『ChatGPT』 神奈川の市役所では"全国初"業務導入」NHK

https://www3.nhk.or.jp/news/html/20230420/k10014043781000.html

*2

「数千ページのマニュアル改訂『ChatGPT』活用へ 農林水産省」NHK

https://www3.nhk.or.jp/news/html/20230418/k10014042001000.html

*3

「ChatGPT『欧州で規制広がる恐れ』 データ法制専門家」日本経済新聞

https://www.nikkei.com/article/DGXZQOUC020H20S3A400C2000000/

*4

「ChatGPT、イタリアが一時禁止 米では差し止め要請」日本経済新聞

https://www.nikkei.com/article/DGXZQOGN31DUY0R30C23A3000000/

*5

「ChatGPT、情報漏洩を防ぐには? データ専門家に聞く」日本経済新聞

https://www.nikkei.com/article/DGXZQOUC229FO0S3A320C2000000

*9

「ChatGPTなどの"生成系AI" 活用企業の最前線では」NHK

https://www3.nhk.or.jp/news/html/20230417/k10014040781000.html